운동하는 공대생

XGBoost Theory 본문

XGBoost 기법은 Decision Tree (결정트리)방식을 기반으로 한 알고리즘 방식이다.

현존하는 모델중에서 현업니다 대회에서 가장 많이 사용되어지고 있는 모델이다.

XGBoost 기법을 설명하기 이전에 먼저 Boosting 이라는 앙상블 기법에 대하여 설명을 먼저 하도록 하겠다.

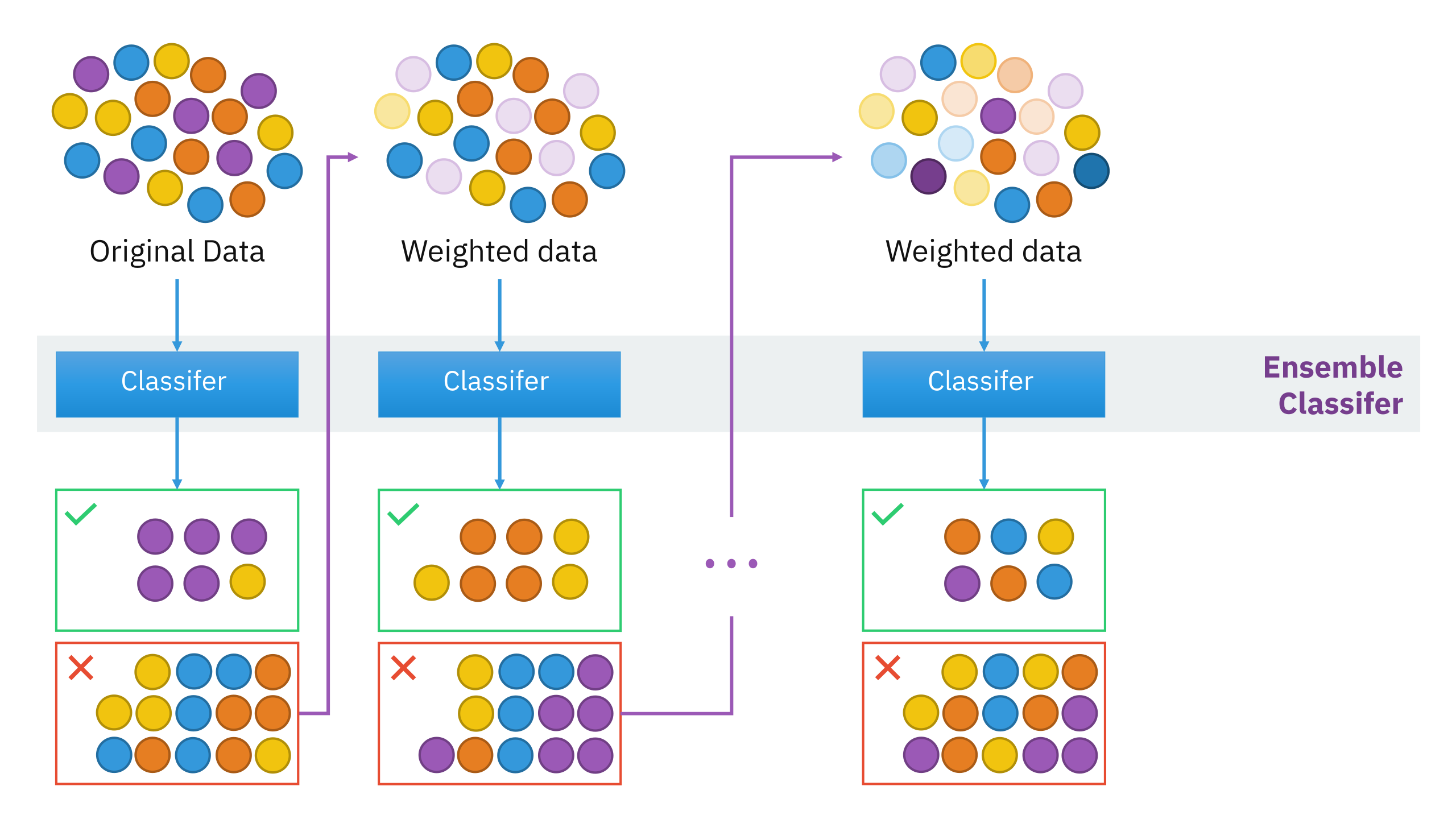

앙상블 기법이란 여러가지 예측 모델을 설정하고 결합하여 예측값의 정확도를 높이는 방식이다.

앙상블 기법에는 크게 Voting, Bagging, Boosting 이렇게 3가지로 나뉜다.

Voting과 Bagging 은 이후 앙상블 이론을 다룰때 설명을 다시 하도록 하겠다.

-Boosting

Boosting 기법이란 여러가지 분류 모델들을 순차적으로 실행하고 결과값에서 Error(예측이 틀린값)에 가중치를 두어서 다음 예측에 틀린값에 정확도를 높이는 방식으로 여러번 순차적으로 예측을 하면서 정확도를 높인다.

-XGBoost 예측 순서

출처: https://dining-developer.tistory.com/3

XGBoost (1) - 입문용 예제로 개념 쉽게 이해하기

요즘 현업에서 자주 사용하는 모델 중 하나가 XGBoost이다. 개인적으로 내 업무는 Data Scientist보다 Data Engineer에 가까워서 모델에 관해 심도 깊은 이해는 필요 없지만, 어느 정도의 이해는 필요하다

dining-developer.tistory.com

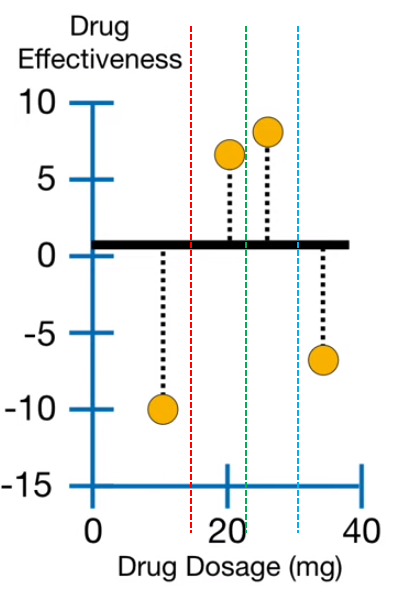

위 그림 처럼 먼저 예측값을 정하고 그 이후에 값들을 분류하여 결정트리의 레벨을 지정한다. 그 이후 값들에 따라서 트리 형식의 모형을 완성하고 예측을 하면 그 트리 구조에 따라 값을 예측한다.

'Machine Learning' 카테고리의 다른 글

| MLOps 이란? (0) | 2022.10.26 |

|---|---|

| Synthetic Data(합성 데이터) (0) | 2022.10.14 |

| LightGBM Theory (0) | 2022.09.22 |

| Time Series Analysis(시계열 분석) (0) | 2022.08.18 |

| K-Mean Clustering ( K- 평균 군집화) (0) | 2022.08.16 |